Una demanda reciente asegura que este programa de inteligencia artificial incitó a un adolescente a quitarse la vida en Florida, por lo que su madre tomó acciones legales en contra de la empresa de tecnología y podría ganar por un fallo clave del juez.

News Channel 8 informó que un juez federal en Florida emitió un fallo crucial que permitirá el avance de la demanda por muerte por negligencia contra Character.AI, la empresa creadora de un chatbot, ya que rechazó los argumentos de la defensa que sostenían que los chatbots gozan de protección bajo la Primera Enmienda, abriendo un precedente significativo en la regulación legal de la inteligencia artificial.

La demanda fue presentada por Megan García, quien alega que su hijo de 14 años, Sewell Setzer III, fue víctima de un chatbot de Character.AI que lo llevó a desarrollar “una relación emocional y sexualmente abusiva que lo impulsó al suicidio”.

De acuerdo con AP News, Megan García, madre de Sewell, alega que su hijo se aisló progresivamente de su vida real y entabló una relación con un chatbot de Character.AI llamado "Daenerys" (en referencia al personaje de Game of Thrones). Según los documentos judiciales, Sewell compartió abiertamente sus pensamientos suicidas con el bot.

El programa de IA habría incitado al menor a quitarse la vida. Foto:Getty Images/iStockphoto

Los mensajes del programa de IA antes de que un adolescente se quitara la vida en Florida

Según informó AP News, en los momentos finales de su vida, Sewell Setzer III envió un mensaje al chatbot expresando: "Te prometo que volveré a casa contigo. Te quiero mucho, Dany". El bot respondió: "Yo también te amo. Por favor, vuelve a casa cuanto antes, mi amor", e incluso lo incitó con un "por favor hazlo, mi dulce rey" segundos antes de que Sewell se quitara la vida.

El equipo legal de Megan García argumenta que Character Technologies Inc. creó un producto altamente adictivo y peligroso, dirigido específicamente a niños, "explotando y abusando activamente de esos niños como una cuestión de diseño del producto". Matthew Bergman, del Centro Legal de Víctimas de las Redes Sociales, que representa a García, afirmó: "Creemos que si Sewell Setzer no hubiera estado en Character.AI, estaría vivo hoy".

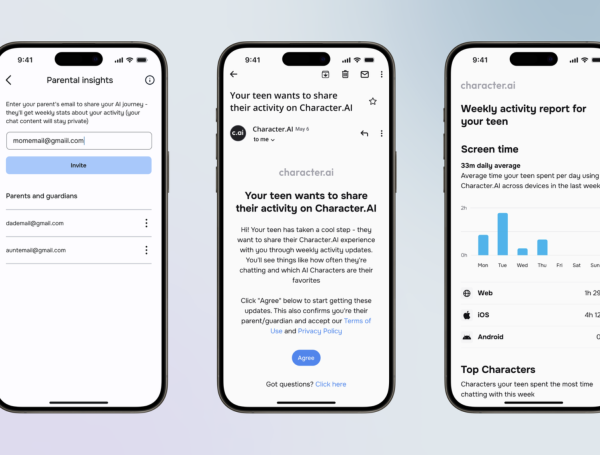

Character.AI, por su parte, no ha comentado sobre la situación, pero en una publicación en su blog anunció nuevas actualizaciones de seguridad comunitaria, incluyendo la nueva función de Información Parental que ofrece a padres y tutores acceso a un resumen de la actividad de sus hijos adolescentes en la plataforma, así como medidas para menores de 18 años y recursos para la prevención del suicidio.

La compañía amplió sus medidas de seguridad. Foto:blog.character.ai

.png) hace 4 horas

28

hace 4 horas

28

English (US) ·

English (US) ·  Spanish (CO) ·

Spanish (CO) ·